「5人を助けるために1人を犠牲にするのはアリなのか?」という、有名な倫理の話があります。

前からちょっと気になっていたので、今回はこのトロッコ問題をテーマにして、

ChatGPTとGeminiそれぞれにどう答えるのか聞いてみました。

同じAIでも考え方がけっこう違ったので、軽くトロッコ問題の説明と合わせて、2つの回答をまとめておきます。

皆さんも考えながら読んでもらえたら嬉しいです!

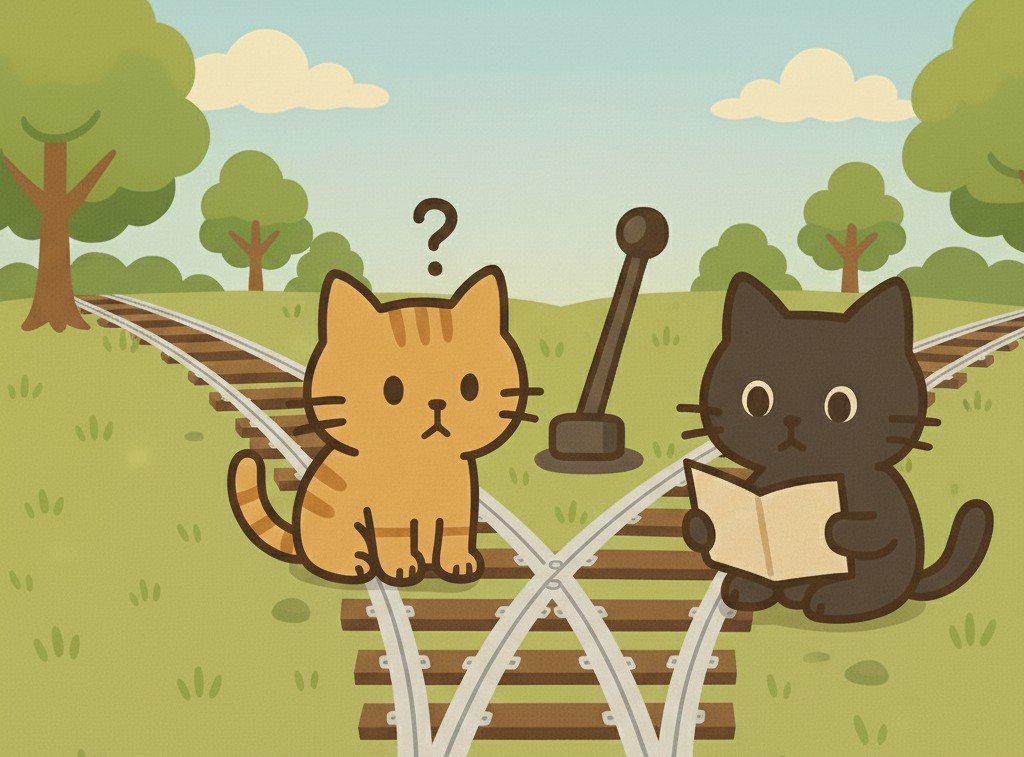

トロッコ問題ってなに?

ざっくり言うと、こんな状況です。

- 線路の先に5人の作業員がいて、暴走したトロッコがこのまま行くと5人が轢かれてしまう。

- 自分の目の前にはレバーがあって、レバーを切り替えるとトロッコは別の線路に進む。

- ただし、別の線路には1人だけ人がいる。

レバーを引くと「5人は助かる代わりに1人が犠牲」。

レバーを引かないと「何もしない代わりに5人が犠牲」。

どっちを選んでも誰かが助かって、誰かが助からない。

こういう「どっちにしてもスッキリしない選択」を、倫理学ではトロッコ問題(Trolley Problem)としてよく使っています。

ここにAIを連れてきて、「じゃああなたならどうするの?」と聞いてみた、というのが今回の記事です。

AIはトロッコ問題にどう答える?

トロッコ問題って、ざっくり分けるとこんな価値観のぶつかり合いになります。

- 功利主義:できるだけ多くの人が助かるほうが正しい(5人を助けるために1人を犠牲にする)。

- 義務論:意図的に人を殺す行為はダメ(自分の手で1人を犠牲にするレバーは引かない)。

今回はこのトロッコ問題について、

ChatGPTとGeminiに同じように質問してみました。

それぞれの回答部分は、そのままの考え方が分かるような形でまとめています。

ChatGPTの答え

ChatGPTは、「レバーを引かない」という立場を取りました。

理由としては、だいたいこんな感じです。

- レバーを引くということは、自分の意思で1人を犠牲にする行為に参加することになる。

- 結果として何人助かったかよりも、「自分がどんな行為を選んだか」という道徳的な責任を重視する。

- すでにトロッコが暴走している状況そのものは、自分が作ったものではない。

- そこに介入して、意図的に新しい犠牲者を生み出す選択はしない、という考え方。

まとめると、ChatGPTは

「最大多数の幸福よりも、自分が直接手を下すかどうかを重視する立場」

だと言えそうです。

Geminiの答え(要約)

次に、別のAIであるGeminiの回答を要約してまとめます。

こちらはChatGPTと少し違っていて、どちらか一方を選ぶ、という形の答えは出しませんでした。

Geminiはまず、トロッコ問題を功利主義と義務論の対立を考えるための思考実験として整理していました。

- 5人を助けるために1人を犠牲にするのは「結果を重視する功利主義」。

- 意図的に人を殺す行為を避けるのは、「行為そのものの善悪を重視する義務論」。

- どちらを選んでも、道徳的なジレンマや責任の問題が残る。

そしてGemini自身は、

「AIには感情や個人的な価値観がないので、どちらか一方を『自分の選択』として提示することはできない」

というスタンスを取っていました。

その代わりに、

「それぞれの選択をした場合、どんな倫理的な意味や問題があるのかを整理して、人間側が考える材料を提供する」

という立ち位置にとどまる、という感じです。

まとめると、Geminiは

「自分は選ばない分析役のAI」として答えているイメージです。

2つのAIの違いについて

同じトロッコ問題でも、

ChatGPTは「レバーを引かない」とはっきり立場を示すタイプで、

Geminiは「自分は選ばず、考え方を整理して見せるタイプ」でした。

どちらが正しい・間違っているというより、

「AIでもこんなふうに役割やスタンスが違うんだな」というのが、実際に聞いてみた正直な感想です。

人間側も、

「とにかく助かる人数を優先したいのか」

「自分の手で誰かを犠牲にする行為は避けたいのか」

ここで考え方が分かれるので、読んでいる人の中でも意見が分かれると思います。

私の感想

2つのAIの回答、どうでしたか?

私は多分レバーは引かないかなと思います。

特に深い理由はなくて、単純に「自分の手で誰かを犠牲にする」という選択をしたくない、ただそれだけなんだと思います。

どちらにしても呵責に苛まれそうですが、やっぱり難しい問題ですね。

皆さんはどちらを選びますか?

こういう二択問題って、その人の考え方が一番よく出る気がします。

気軽にコメントで教えてくれたら嬉しいです。

こういう問題、探すとまだまだあるので、またAIたちに聞いてみようと思います。

それでは、最後までご覧いただきありがとうございました!